Lumen, Realidad Aumentada sin gafas

Desde sus inicios, uno de los problemas con los que se ha tenido que enfrentar la tecnología de Realidad Virtual (y posteriormente lo que conocemos como Realidad Aumentada) es la dificultad de crear un hardware (gafas, guantes, etc.) que permita al usuario “sumergirse” en el entorno generado por el ordenador con libertad de movimientos y las menores molestias posibles. El primer visor de Realidad Virtual, desarrollado por Ivan Sutherland y Bob Sproull en 1968, fue apodado “la espada de Damocles” debido a que, por el peso del dispositivo, tenía que estar sujeto por un brazo mecánico sujeto al techo. A medida que la tecnología ha evolucionado y se ha miniaturizado, los visores de RV se han hecho cada vez más ligeros y asequibles, llegando en los últimos años al gran público, ya sea como dispositivos de entretenimiento y creación como los que actualmente comercializan Facebook, Sony, Google y otras empresas o como simples carcasas de cartón o plástico en las que se inserta un smartphone. A esto se suman los dispositivos de Realidad Aumentada que procuran convertirse en complementos de uso diario, como ya intentó Google con su proyecto Glass o está desarrollando Facebook en forma de unas sencillas gafas de pasta. Con todo, estos visores se ciñen a la idea original de Sutherland, procurando mediar entre los sentidos del usuario y su entorno, lo cual es necesario en el caso de la Realidad Virtual pero no lo es tanto en la Realidad Aumentada. Ya en 1969, el ingeniero y artista Myron Krueger trabajaba en prototipos de RV y empezó a buscar alternativas a los dispositivos creados por Sutherland y Sproull. En 1970 empezó a desarrollar la idea de un “entorno reactivo” que respondiese a la presencia y los gestos del usuario. Denominado Videoplace, este proyecto parte de la insatisfacción de Krueger con el visor de RV. En una entrevista con Jeremy Turner en 2002, el pionero de la Realidad Virtual afirmaba:

“En 1970, tuve en cuenta los HMD (Head Mounted Display o casco de Realidad Virtual) y los rechacé porque consideré que cualquier beneficio que pudiesen aportar en cuanto a la inmersión visual era contrarrestado por el estorbo que suponía la parafernalia que, en mi opinión, distanciaba a los participantes del mundo en el que se suponía que debían sumergirse. Cuando consideré cómo sería la experiencia ideal, decidí que no debía distinguirse de una experiencia real. No se trataría de separarse de la realidad por medio de un proceso en el que hay que ponerse un traje, colocarse dispositivos en el cuerpo y estar atado a un ordenador por medio de cables. En vez de ser un mundo alienígena al que se accede por medio de una escotilla, sería una puerta a un mundo fantástico en el que entras tan sólo estando allí.”

El trabajo de Krueger se basó en crear un entorno en el que el ordenador pudiese detectar la presencia del usuario y responder a sus movimientos, dando lugar a un modelo de interacción que ha tenido una gran influencia y se ha popularizado en dispositivos como Kinect además de en innumerables otras aplicaciones y proyectos artísticos. Actualmente existen diversas iniciativas que crean aplicaciones de Realidad Aumentada sin necesidad de que el usuario tenga que llevar puesto un dispositivo. Una de ellas es Lightform, un sistema que consiste en un proyector instalado en el techo capaz de detectar los objetos sobre los que proyecta la luz y generar contenidos que responden a su forma y posición. Esta tecnología se plantea inicialmente como una solución para crear una “pared reactiva” en la que se pueden colocar objetos o marcos que el proyector puede llenar de contenidos dinámicos según las preferencias del usuario.

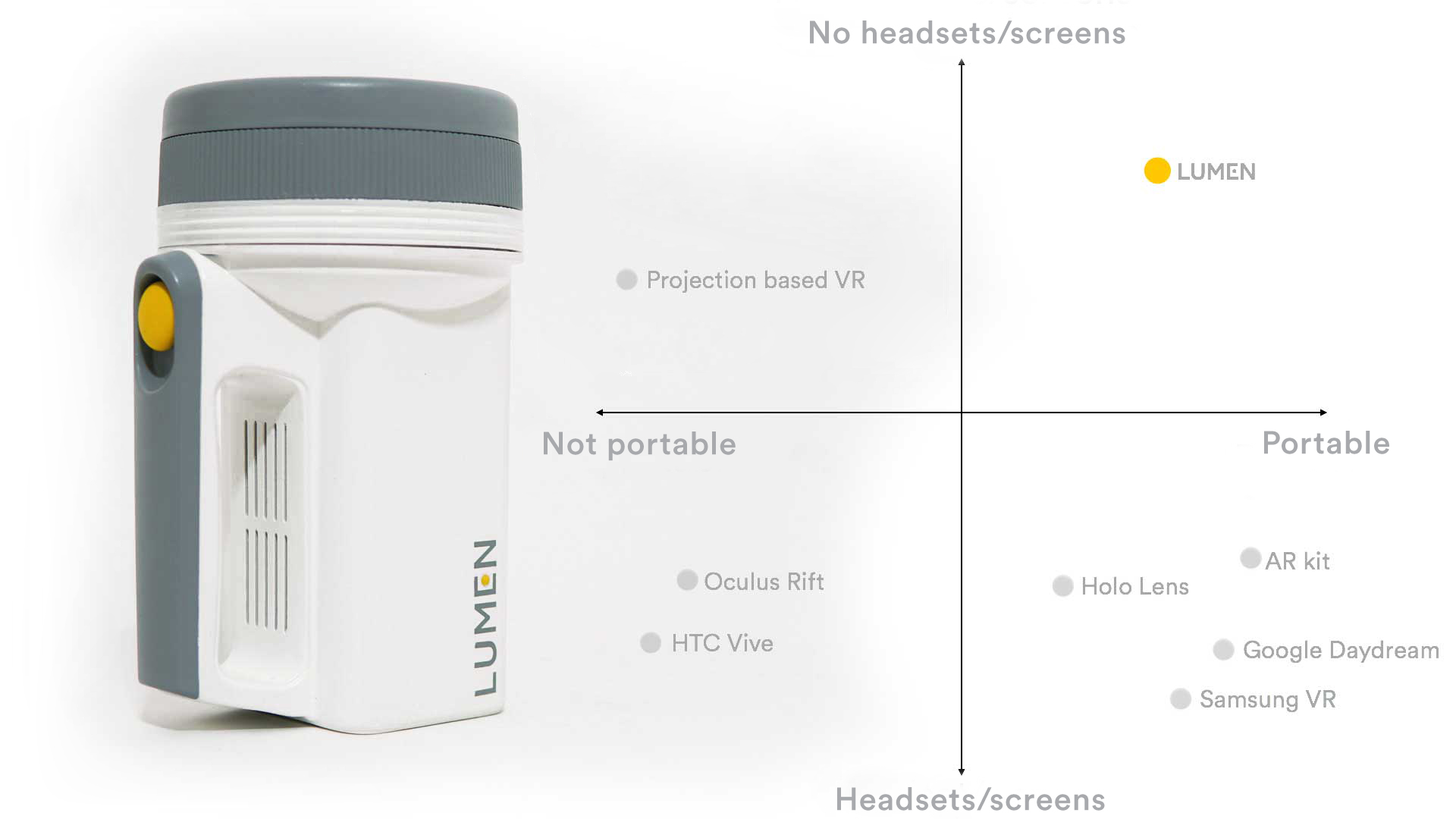

Un proyecto muy parecido que se ha lanzado recientemente es Lumen, un dispositivo en forma de linterna que puede reconocer las formas en las que se proyecta la luz y generar contenidos adaptados a la forma y el tipo de objeto escogido. Creado por el diseñador Arvind Sanjeev, el dispositivo emplea tecnologías de mapping e inteligencia artificial para “activar” determinados objetos que han sido previamente definidos y para los que se ha creado un contenido específico. Según afirma Sanjeev, la inspiración para este proyecto ha sido “imaginar un futuro sin pantallas en el que las personas interactúan con su entorno”, de manera similar a cómo Krueger imaginó una Realidad Virtual sin visores ni la “espada de Damocles.” Combinando una cámara, un proyector y un sensor de profundidad, Lumen detecta los objetos y capaz de clasificarlos e identificarlos, para posteriormente proyectar los contenidos previamente diseñados sobre esos objetos clasificados. Así, por ejemplo, es posible generar un contenido específico para una taza de café, de manera que cuando se proyecte la luz sobre cualquier taza, aparezca dicho contenido, adaptado a su forma por medio de la técnica de mapping. Según se muestra en un vídeo promocional, esto se puede aplicar a objetos más específicos, como por ejemplo esculturas clásicas en un museo, y también convertir las superficies proyectadas en interfaces, puesto que es posible interactuar con la proyección colocando o moviendo un dedo sobre la imagen. En este sentido, la tecnología empleada se parece a otras soluciones previamente desarrolladas, como el mencionado Lightform o mesas interactivas como la creada para el instrumento musical Reactable. Con todo, Lumen se distingue por su portabilidad y versatilidad, dado que es posible proyectar la luz sobre cualquier objeto y por tanto abre muchas posibilidades de desarrollo. En la tabla inferior, Sanjeev compara su invento con otros dispositivos disponibles en el mercado, situándose como la única solución portátil que no requiere visores o pantallas.

Lumen plantea una solución interesante para el desarrollo de la Realidad Aumentada en ciertos entornos (principalmente espacios cerrados en los que la luz ambiente no impida ver los contenidos proyectados), que resulta atractiva precisamente por su portabilidad y capacidad de adaptarse a diferentes usos. Tal vez uno de los escenarios más factibles sería un espacio de entretenimiento, en el que los usuarios podrían, por ejemplo, jugar a un juego en el que van descubriendo claves o siguiendo una narración a medida que dirigen sus linternas a determinados objetos. Un museo de escultura podría puntualmente acoger un dispositivo como éste, si bien el hecho de facilitar a los visitantes numerosas linternas que pueden dirigir hacia cualquier lugar plantea evidentes problemas, a los que se suma la imposibilidad de emplear este dispositivo en museos cuyas obras de arte puedan verse afectadas por la luz (como por ejemplo, pinturas, dibujos o grabados.) En un entorno cotidiano, sería posible emplear Lumen para “aumentar” determinados objetos, pero claramente las dimensiones del propio dispositivo lo hacen muy poco práctico para su uso diario: nadie va a pasearse por la casa con una linterna de estas dimensiones apuntando a los objetos que le rodean y tratando de interactuar con ellos con una mano mientras sostiene la linterna con la otra. Posiblemente, la miniaturización de la tecnología que emplea este proyecto sea la que haga posible en el futuro que este concepto llegue a popularizarse. Si en vez de una linterna de gran tamaño fuese posible interactuar con un dispositivo del tamaño de un smartphone, o incluso pudiese integrarse esta tecnología en un smartphone, entonces resultaría más plausible su uso en un entorno cotidiano. Mientras tanto, Lumen supone una propuesta interesante pero más bien experimental, que continúa una línea de integración de los contenidos generados por un ordenador en nuestra percepción del entorno. Como afirmaba el propio Krueger, “criticar una nueva idea porque no se ha realizado aún del todo me parece poco razonable e impaciente.” Cabe esperar de qué manera puede desarrollarse la solución que propone Sanjeev a través de Lumen y cómo puede integrarse en nuestra interacción cotidiana con los ordenadores y los objetos que nos rodean.

Referencias

Myron W. Krueger (1989). “VIDEOPLACE–Eine künstliche Realität”. Ars Electronica Archive.

Arvind Sanjeev (2018). “Lumen: Reimagining Immersion”. Arvind Sanjeev.

Ivan E. Sutherland (1968 [1990]). “A HEAD-MOUNTED THREE-DIMENSIONAL DISPLAY”. Ars Electronica Archive.

Jeremy Turner (2002). “Myron Krueger Live”. C-Theory.